Aux cinq « enfumages » que démontent Lou Welgryn et Théo Alves Da Costa dans IA. Le grand enfumage s’en ajoute un sixième, qu’ils n’isolent pas comme tel mais que leur livre rend visible de part en part : la manière dont l’industrie de l’IA se rend nécessaire avant même d’avoir prouvé sa nécessité.

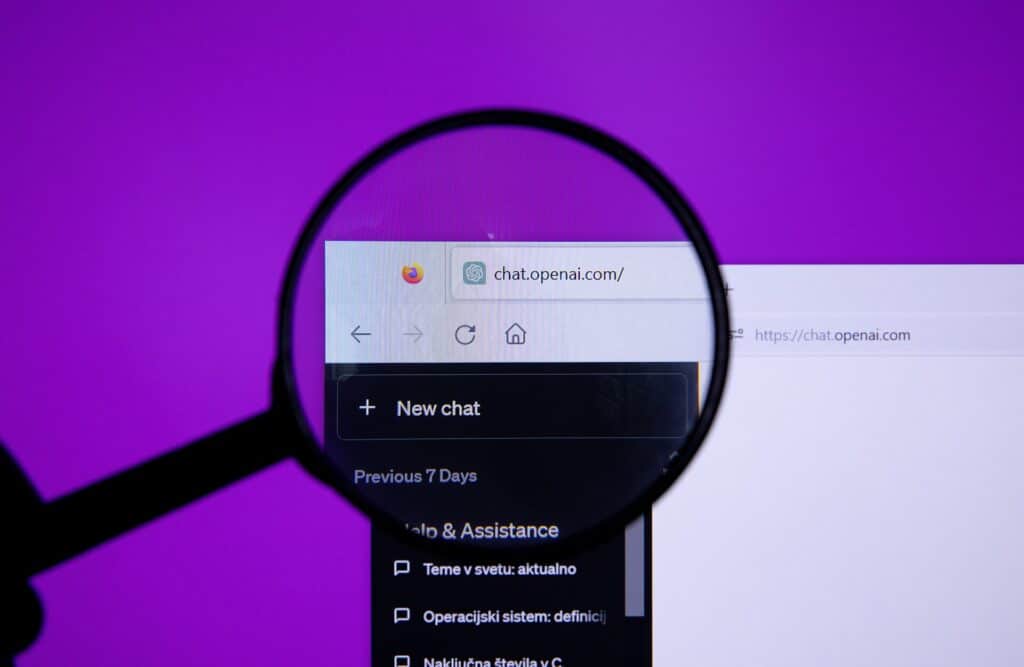

Ce que le livre de Lou Welgryn et Théo Alves Da Costa montre avec le plus de netteté ne réside ni dans la démesure des chiffres ni dans le théâtre des dirigeants. Il tient dans une remarque qu’on rencontre au cœur du dernier chapitre : un État qui dépend d’un opérateur cloud étranger pour faire tourner ses hôpitaux, écrivent les auteurs, ne négocie plus en position de force. Une école qui distribue un assistant conversationnel, un hôpital qui externalise ses dossiers, une administration qui confie ses calculs : l’industrie de l’IA s’installe d’abord là où l’on ne pourra plus la refuser.

Lou Welgryn dirige Data For Good et fut auparavant experte climat chez Carbone 4 ; Théo Alves Da Costa, ingénieur en analyse de données, préside la même association et siège au collège d’experts sur l’intelligence artificielle du septième cycle d’évaluation du GIEC. Ils écrivent depuis un savoir-faire technique qui leur interdit l’illusion confortable du surplomb – et c’est ce qui distingue leur livre de presque tout ce qui s’est publié récemment sur le sujet. La table des matières égrène cinq « enfumages » successifs : la mythologie d’une IA quasi miraculeuse, la course géopolitique entre puissances, le coût environnemental d’une infrastructure dévorante en eau et en énergie, les promesses d’un quotidien augmenté qui dégradent en réalité l’attention et la cognition, enfin les ressorts politiques d’une industrie qui pèse sur les démocraties. Dès leur introduction, les auteurs revendiquent trois principes méthodologiques : démolir les mythes, casser l’abstraction, nommer le pouvoir. Mais le geste réel du livre, lui, déborde son plan affiché.

Le matériau qui le porte est massif. Un seul ordre de grandeur en donne la mesure : pour couvrir ses pertes et tenir ses engagements, l’industrie de l’IA générative devrait engendrer d’ici 2030 quelque deux mille milliards de dollars de revenus cumulés. C’est, en cinq ans, l’équivalent des marchés mondiaux du logiciel et de la publicité réunis. Cette disproportion ressemble peu à un accident de jeunesse. Chaque utilisateur supplémentaire coûte plus cher qu’il ne rapporte ; chaque génération de puces spécialisées impose un renouvellement complet du parc tous les deux ou trois ans ; chaque nouveau modèle exige une infrastructure plus vorace que le précédent.

Les auteurs montrent que l’industrie n’a pas un problème de rentabilité : elle repose sur un modèle dont la rentabilité, si elle advient un jour, ne pourra venir qu’au prix d’une concentration extrême. À titre de repère, OpenAI projette de perdre cent quinze milliards de dollars entre 2024 et 2028 – soit, en deux fois moins de temps, plus du triple des pertes structurelles accumulées par Uber en treize ans. Pour ne pas s’effondrer dans l’intervalle, l’industrie doit lever des sommes toujours plus colossales : Sam Altman, en 2025, en a réclamé sept mille milliards de dollars – plus de deux fois le produit intérieur brut de la France – et Satya Nadella, le patron de Microsoft, le reconnaît lui-même : Altman avance ces chiffres pour pouvoir lever de quoi payer ses factures de calcul.

Mais le plus inquiétant n’est pas ce que ces sommes représentent. C’est la manière dont elles circulent. Welgryn et Alves Da Costa montrent que NVIDIA investit massivement dans OpenAI, qui s’engage à acheter des serveurs à Oracle, qui à son tour rachète des puces à NVIDIA. L’argent tourne en rond, gonflant les revenus comptables de chacun sans qu’aucun profit nouveau entre dans le système. Et David Sacks, conseiller spécial à la Maison-Blanche pour l’IA et la cryptomonnaie, le concède sans détour : la course est peut-être infinie.

Cet exposé financier ne serait pas neuf si les auteurs s’arrêtaient là. Mais leur lecture en tire une conséquence que la critique ordinaire de la « bulle » technologique laisse toujours dans l’ombre : faute de pouvoir être rentable au sens classique, l’industrie doit devenir indispensable. Sa solvabilité ne dépend plus de ses clients, mais de la conviction collective qu’on ne pourra plus s’en passer.

C’est pourquoi le récit n’est pas un emballage publicitaire venu se greffer après coup sur la mécanique économique – il en est l’instrument central. La rhétorique de l’« infrastructure du futur », les comparaisons répétées avec les chemins de fer et l’électricité, l’agitation permanente d’un épouvantail chinois, le FOMO – cette peur d’être dépassé – entretenu jusque dans les conseils des ministres : ce ne sont pas des décorations idéologiques, ce sont les composants d’une mécanique unique qui transforme un pari industriel en obligation collective.

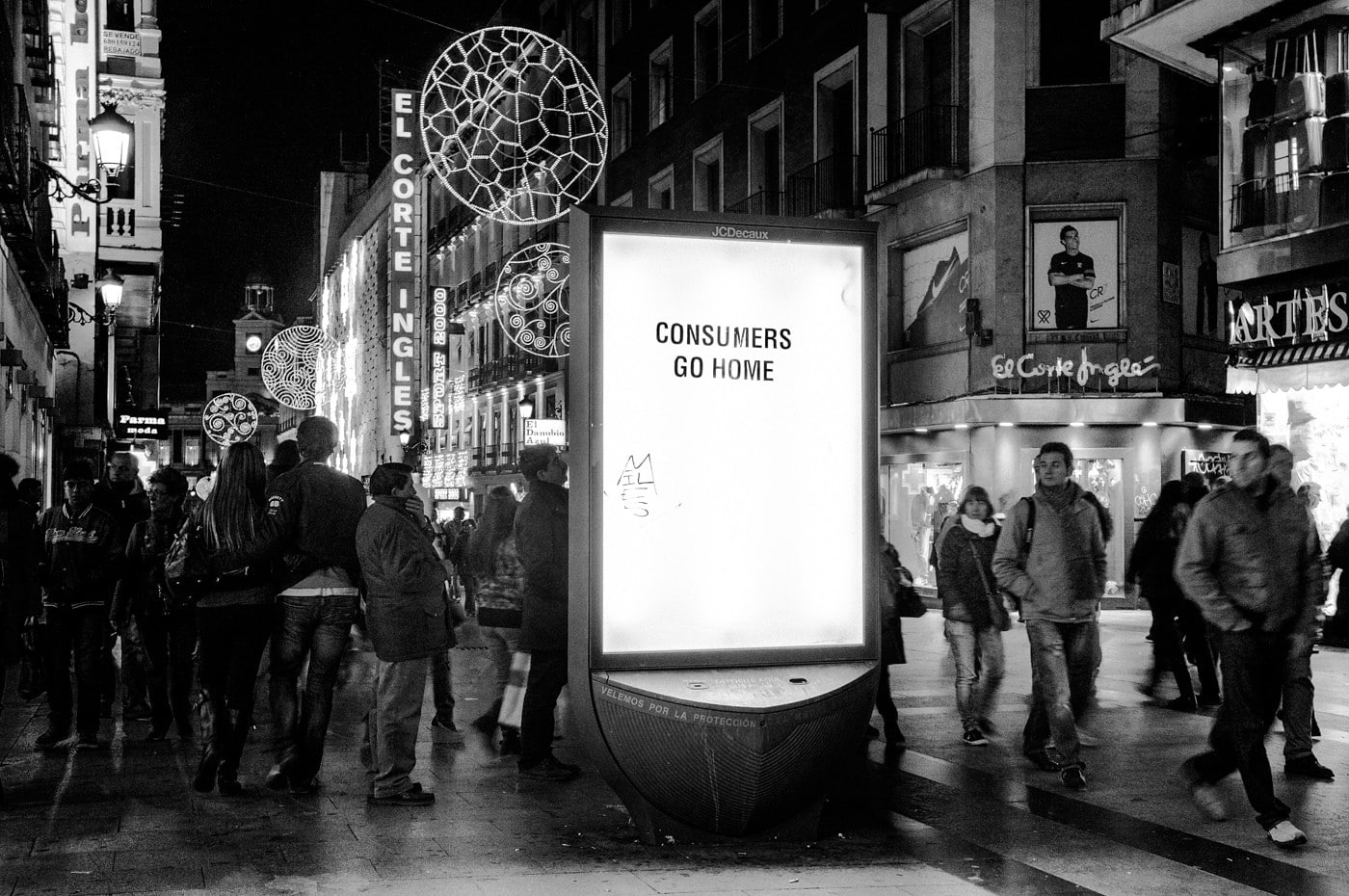

Et lorsque le récit ne suffit plus, l’industrie passe en force : assistants imposés par défaut dans les suites bureautiques, abonnements gratuits offerts aux écoles, « futur vivier de clients payants » de l’industrie, fonctionnalités déployées sans que l’utilisateur ait à les demander – un harcèlement-by-design, comme l’écrivent les auteurs. Derrière chaque promesse, le livre fait surgir une question : qui paie déjà ?

C’est ici que les cinq enfumages cessent d’être cinq. Les trois principes – démolir, casser, nommer – dessinent en creux un quatrième mouvement qui les articule. La course n’est pas un thème parmi d’autres : elle est la forme même que prend une industrie contrainte, pour exister, de fabriquer sa propre nécessité. Là où Daniel Andler, recensé ici même en janvier 2024, aidait à sortir de la confusion conceptuelle attachée au sigle « IA » en en distinguant les usages, les techniques et les histoires, Welgryn et Alves Da Costa s’attachent à tout autre chose : non plus à ce que le terme désigne, mais à ce que son flou autorise à administrer comme déjà acquis. Le déplacement est décisif : il fait passer la question de l’ordre du concept à celui du régime d’acceptation.

Le passage le plus précieux du livre est aussi l’un des plus brefs. Les auteurs y nomment le mécanisme qui soutient l’ensemble. La dépendance progressive des services publics, des canaux de communication et des outils de recherche à une demi-douzaine d’acteurs américains n’est pas, écrivent-ils, une dérive involontaire : elle procède d’une stratégie délibérée, jouée par petits gestes – un contrat avec les armées d’un côté, un accès gratuit pour les écoles de l’autre. Cette construction lente constitue à leurs yeux « le verrou le plus solide du pouvoir de l’industrie de l’IA ».

On peut lire ces points d’enracinement comme quatre verrous déposés simultanément. L’école, parce qu’elle façonne les usages des futurs adultes. L’armée, parce qu’elle a les moyens de payer et l’urgence de ne pas attendre. L’hôpital, parce qu’on ne suspend pas les soins le temps d’une migration informatique. L’administration, parce qu’elle est le lieu où le citoyen ne choisit pas son fournisseur. Quatre verrous qui renversent la chronologie habituelle de la dépendance : ordinairement, on s’inquiète d’un assujettissement après qu’il est advenu ; ici, le mouvement précède l’usage.

La démonstration convainc. Elle gagnerait encore en force si les auteurs en éprouvaient eux-mêmes la limite. Ils établissent que l’industrie ne peut pas être rentable au sens classique et que sa solvabilité repose sur la fabrication de sa nécessité ; ils n’examinent pas, en revanche, le scénario qui inquiète le plus leur lecteur : celui où la rentabilité finirait par advenir précisément grâce à cette fabrication, quand la banalisation des usages, jointe à une concentration extrême et au verrouillage des services publics, produirait les revenus que les modèles n’auraient su générer seuls. Ce n’est pas une objection au livre, mais le seuil de sa lecture : signaler ce que les auteurs n’examinent pas n’affaiblit pas leur thèse, cela en indique au contraire la portée.

Cette lecture éclaire alors leur position politique, qu’on aurait tort de rabattre sur un militantisme convenu. Welgryn et Alves Da Costa ne plaident pas pour un retour en arrière ; ils ne moralisent ni les usages individuels ni les choix d’entreprise. Leur insistance sur la « techno-lucidité » signale qu’ils savent où ils écrivent : depuis un monde où l’IA est déjà partiellement installée, et où la question pertinente n’est plus de savoir s’il faut l’accueillir mais à qui revient le pouvoir de décider ce qu’on en fait. La dernière partie du livre s’intitule « Reprendre le pouvoir » et l’on aurait pu craindre la formule. Elle dit pourtant ce qu’elle annonce : cartographier les dépendances avant qu’elles ne se referment, casser les monopoles avant qu’ils ne deviennent des infrastructures, ouvrir les verrous techniques tant qu’il en est temps – depuis les choix individuels jusqu’aux décisions publiques.

Le livre de Welgryn et Alves Da Costa ne dit pas que l’IA est mauvaise. Il dit que sa nécessité a été fabriquée avant d’avoir été prouvée – et que cette précipitation n’a rien d’un accident : elle est sa condition de survie. Reste alors une question qui n’est plus technique : qui décide encore, quand l’école, l’administration et l’hôpital ont déjà été engagés ?